OpenClaw 踩坑记:我劝你用最好的模型,笨模型相当于招了个笨助理

上周一个朋友跟我吐槽。

他看了我之前写的 OpenClaw 教程,兴冲冲地装了一套。配好了 WhatsApp,接上了 API Key,准备体验传说中的”AI 贾维斯”。

但他为了省钱,选了最便宜的模型——Haiku。

结果呢?让它帮忙写个 Python 脚本,写出来的代码跑不通。让它改 Bug,越改越多。让它分析一个文件,它幻觉出了三个不存在的函数。最后他花了两个小时”教”AI 做一件本来 20 分钟就能搞定的事。

他跟我说:”这玩意儿就像我招了个实习生,还是那种上班第一天就敢重构你代码的实习生。”

我说:不是工具的问题,是你给它装了个笨脑子。

OpenClaw 是什么?30 秒搞清楚

如果你还不了解 OpenClaw,先快速补课。

OpenClaw 是 2026 年最火的开源 AI 项目——GitHub 上超过 25 万颗 Star,打破了 React 保持了十年的增长纪录。它的创始人是奥地利开发者 Peter Steinberger(PSPDFKit 的创始人),原名叫 “Clawdbot”,因为 Anthropic 的商标投诉改了两次名,最终定名 OpenClaw。

它本质上是一个通用 AI 助手框架。你可以把它接到 WhatsApp、Telegram、Slack、Discord 等十几个平台上,让 AI 帮你管日程、回消息、控制智能家居、跑脚本、写代码——几乎什么都能做。

关键是,OpenClaw 支持多种模型:Claude、GPT-4o、DeepSeek、Gemini,甚至本地的 Ollama 模型。你想用什么就用什么。

自由选择模型,这是 OpenClaw 最大的卖点,也是最大的坑。

因为很多人为了省钱,选了最便宜的模型。然后体验一落千丈,反过来骂工具不行。

模型之间的差距到底有多大?

你可能觉得,模型嘛,差不多的。都是大语言模型,能差到哪去?

差到天上地下。

以 Anthropic 的三个模型为例,SWE-bench Verified(业界最权威的 AI 编程能力基准测试)的得分:

| 模型 | SWE-bench 得分 | 每百万 token 价格(输入/输出) |

|---|---|---|

| Opus 4.6 | 80.8% | $5 / $25 |

| Sonnet 4.6 | 79.6% | $3 / $15 |

| Haiku 4.5 | 73.3% | $1 / $5 |

看起来差距不大?Opus 和 Haiku 只差 7.5 个百分点?

别被数字骗了。 这 7.5 个百分点的差距,在真实使用中是质变,不是量变。

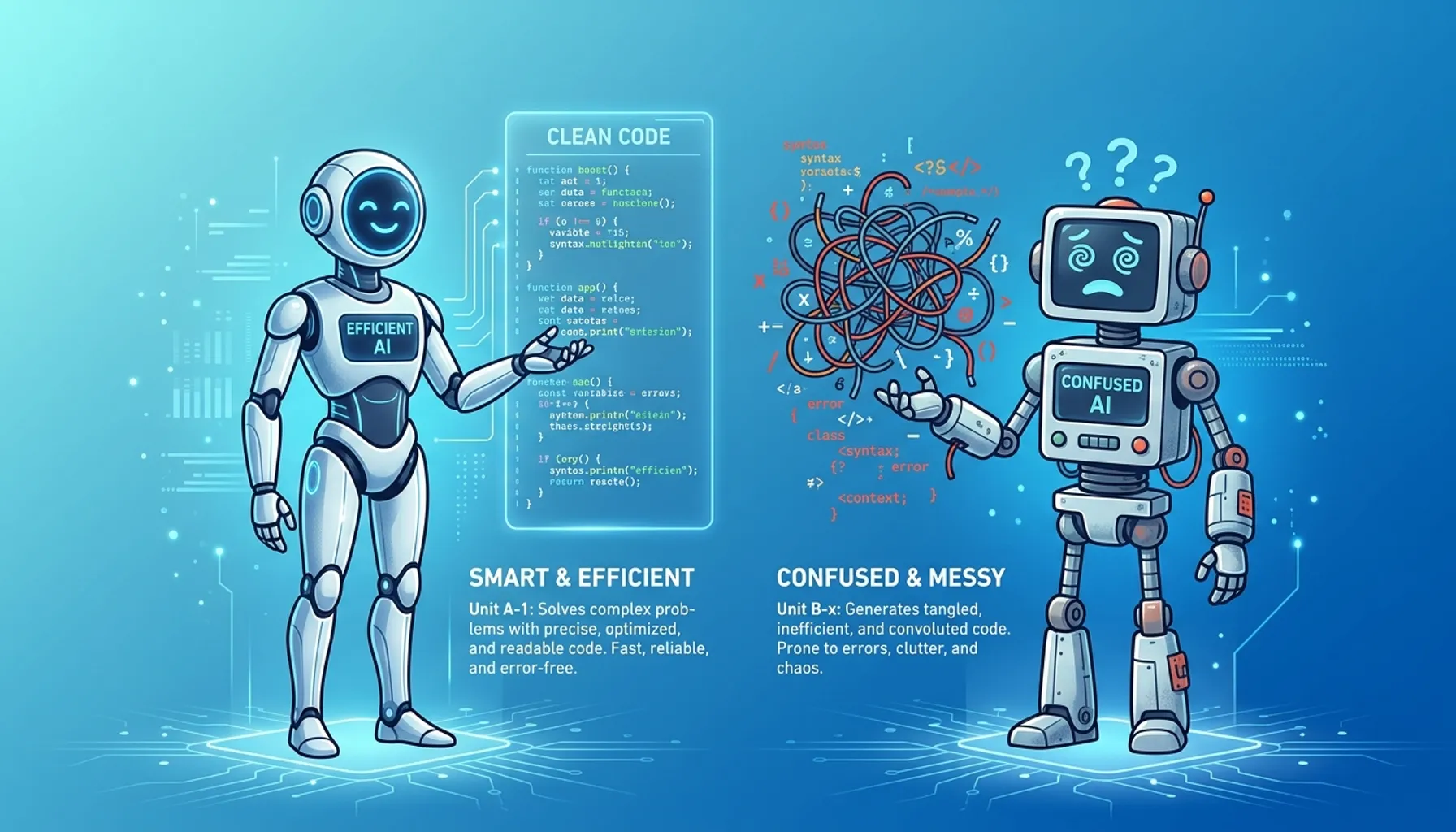

笨模型的三宗罪

一位开发者在做 Flutter 项目时,对三个模型做了真实对比测试。他的总结很到位:

第一宗罪:幻觉。 Haiku 写代码快是快,但它经常”幻觉”不存在的文件名和函数。你让它改 auth_service.dart,它可能会引用一个根本不存在的 user_repository.dart。Sonnet 和 Opus 在这方面明显更可靠。

第二宗罪:失忆。 在长会话中,Haiku 的上下文保持能力急剧下降。它可能在第 10 条消息之后就忘了你在第 3 条消息里说的约束条件。Haiku 甚至不支持 1M 上下文窗口——它的上下文只有 200K,是 Opus 和 Sonnet 的五分之一。

第三宗罪:漏洞。 当那位开发者用 Opus 做最后的代码审查时,Opus 找到了 rebuild 问题、缺失的 dispose、和异步 Bug——这些问题 Haiku 和 Sonnet 完全没发现。

Reddit 上有人的评价更直接:

“Opus 是个怪物。上次用 Haiku 的感觉,就像在教一个 12 岁的小孩怎么集中注意力完成任务。”

另一位用户的比喻也很形象:

“Haiku 就像一个应届毕业生。如果你能信任一个应届生来写工具脚本,那它就够用了。”

“省钱”其实更贵

很多人选弱模型的理由只有一个:省钱。

但这里有一个反直觉的真相:用弱模型可能比用强模型更贵。

为什么?因为弱模型需要更多次的迭代。

一个典型的场景:你让 Haiku 写一个 LRU Cache。它给你一个”能跑但很基础”的版本。你发现边界条件没处理,要求它改。改完发现内存效率很差,又要求优化。优化完发现跟项目里其他模块的接口不兼容,再改。

四轮对话下来,消耗的 token 总量可能比直接用 Opus 一次搞定还多。

Morphllm 的分析印证了这一点:Opus 每个任务的 token 消耗确实更高,但它的”一次性成功率”也更高。用 Opus 做重构,经常一次就对了。用 Haiku 做重构,平均要改 2-3 次。

一位开发者算了一笔账:

“Opus 有时候反而更便宜——因为它第一次就把重构做对了。”

省模型钱,花在了反复修改的时间上。时间不是钱吗?

在 OpenClaw 里,模型差距会被放大

如果你只是在网页聊天界面用 AI,模型的差距还不那么明显——最多就是回答质量有高有低。

但在 OpenClaw 这种 Agent 模式下,模型差距会被急剧放大。

为什么?因为 Agent 是自主执行任务的。它需要自己决定下一步做什么、调用什么工具、怎么处理中间结果。每一步决策都是一次推理。推理能力弱的模型,每一步都可能走偏——而错误会像滚雪球一样越滚越大。

举个例子。你在 OpenClaw 里说:”帮我查一下这周的日程,找出空闲时间,然后在 Uber Eats 上预约一份明天中午的午餐。”

这个任务至少需要:

- 理解”这周”的含义(时间推理)

- 读取日历数据(工具调用)

- 分析空闲时间段(逻辑推理)

- 打开 Uber Eats(工具调用)

- 选择合适的餐厅和时间(决策)

- 下单但不支付(理解约束)

6 个步骤,每一步都需要正确的推理。用 Opus,可能一气呵成。用 Haiku,可能在第 3 步就搞混了时间,然后后面全错。

ClaudeFast 的对比文章说得好:Claude Code 是手术刀,OpenClaw 是瑞士军刀。但不管你用什么刀,刀刃钝了都切不动东西。 模型就是那个刀刃。

最佳模型策略:分层使用

说了这么多,不是说你任何时候都必须用最贵的模型。聪明的做法是分层使用。

Reddit 上一位高赞回答总结了一套被广泛验证的策略:

1 | Opus:负责规划和审查 |

用人话说就是:Opus 是技术总监,做规划和把关;Sonnet 是高级工程师,干大部分活;Haiku 是实习生,跑腿打杂。

你不会让实习生做架构设计。同样,你也不应该让 Haiku 做需要深度推理的任务。

在 OpenClaw 里,如果你的主要用途是自动化日常事务(回消息、查天气、设闹钟),Haiku 或者 Sonnet 就够了。但如果你让它做复杂任务——多步骤自动化、代码生成、数据分析——拜托,给它一个好脑子。

OpenClaw 的其他坑

既然在聊踩坑,顺便说几个跟模型无关的坑。

安全问题

2026 年初,安全研究人员发现了 OpenClaw 的一个严重漏洞 CVE-2026-25253,CVSS 评分 8.8(满分 10)。攻击者可以通过 WebSocket 的源头头绕过,在暴露的 OpenClaw 实例上执行任意代码。

更吓人的数据:研究人员发现了超过 13.5 万个暴露在公网的 OpenClaw 实例,其中 5 万多个直接存在此漏洞。

另外,ClawHub(OpenClaw 的社区技能市场)的安全审计发现,约 12% 的技能存在恶意行为。也就是说,你在技能市场随便装的每 8 个扩展里,可能有 1 个是有问题的。

如果你在用 OpenClaw,请务必:不要把它暴露在公网上,谨慎安装第三方技能,定期更新到最新版本。

安装复杂

Claude Code 30 秒就能装好。OpenClaw 需要配置 Node.js 22+、各个平台的 API Key、LLM API Key,加上调试可能需要 30-60 分钟。Reddit 上关于安装问题的吐槽帖子不计其数。

创始人去了 OpenAI

2026 年 2 月 14 日,Steinberger 宣布加入 OpenAI。OpenClaw 将转交给一个开源基金会管理,背后有 OpenAI 的资金支持。这对项目的长期方向意味着什么?没人知道。但创始人离开,总是一个风险信号。

写在最后

回到最初的话题。

我那个朋友后来换成了 Sonnet,体验立刻好了一大截。再后来在做复杂任务时切到 Opus,他说”感觉像换了一个人”。

AI 工具的上限,不是由工具本身决定的,而是由背后的模型决定的。

OpenClaw 也好,Claude Code 也好,Cursor 也好——它们只是壳。壳再漂亮,里面的大脑不行,输出就是垃圾。就像你买了一辆法拉利的车壳,但装了个奥拓的发动机。外面看着挺唬人,一脚油门下去,原地不动。

所以我的建议很简单:

- 预算允许的话,默认用 Opus。 它贵,但它省时间。时间比钱贵。

- 日常琐事可以用 Sonnet。 性价比最高,80% 的任务它都能胜任。

- Haiku 只用来做最简单的事。 格式化、跑测试、回复模板消息。别指望它做任何需要”思考”的事。

- 在 Agent 场景下,宁可多花钱也要用好模型。 Agent 的错误会级联放大,一步错步步错。

你在用 OpenClaw 或者其他 AI 工具时,有没有因为模型选择吃过亏?你现在的模型策略是什么?欢迎评论区聊聊你的真实体验。