智谱把"会操作手机的AI"开源了:AutoGLM 如何用眼睛+大脑+手接管你的手机

你对着手机说”帮我在美团上点一份黄焖鸡米饭,不要辣,送到公司”。

然后你放下手机,继续开会。

5 分钟后,外卖下单了。AI 自己打开美团,搜索黄焖鸡,选了评分最高的店,勾掉辣椒选项,确认地址,完成支付。整个过程,你的手指没碰过屏幕一次。

这不是概念视频,是 AutoGLM 已经能做到的事情。

2025 年 12 月 9 日,智谱深夜开源了 AutoGLM——一个能”看懂”手机屏幕、自主规划任务、模拟真人操作的 AI Agent 框架。模型(AutoGLM-Phone-9B)用 MIT 协议开源,代码用 Apache-2.0 协议托管在 GitHub。

这意味着任何硬件厂商、手机厂商、开发者,都可以基于 AutoGLM 造出自己的”AI 手机”。

已经支持微信、淘宝、抖音、美团等超过 50 个高频中文应用。有人用它自动刷抖音,有人用它帮忙比价购物,甚至有人让它玩原神。

今天我们来拆解:AutoGLM 到底怎么做到的?”眼睛+大脑+手”的架构设计有多精妙?它和小米 miclaw、豆包手机有什么本质区别?

传统方案的死胡同

在聊 AutoGLM 之前,先理解一个问题:为什么”AI 操作手机”这么难?

方案一:无障碍服务(AccessibilityService)模拟点击。 豆包手机助手用的就是这条路。通过 Android 的无障碍权限,模拟用户的点击和滑动。问题是:第三方 App 可以检测到这种模拟行为,判定为”外挂”,导致封号。豆包因此被多个超级 App 围堵。

方案二:系统级 API 调用。 小米 miclaw 用的是这条路。通过 Intent 驱动和 AIDL 协议直接调用系统接口。优点是稳定、不会被封号;缺点是必须和手机系统深度绑定,只能在小米设备上用,而且能操作的范围取决于系统开放了多少 API。

方案三:读取 UI 树(View Hierarchy)。 通过解析 Android 的视图层级,理解界面上有哪些元素。问题是:大多数 App 开发者根本不在意无障碍标签。一个按钮可能叫 “Button1”,一个输入框可能没有任何描述。AI 读到的是一堆无意义的标签,根本不知道哪个是”下单”按钮。

三条路,三个死胡同。

AutoGLM 走了第四条路:直接看屏幕。

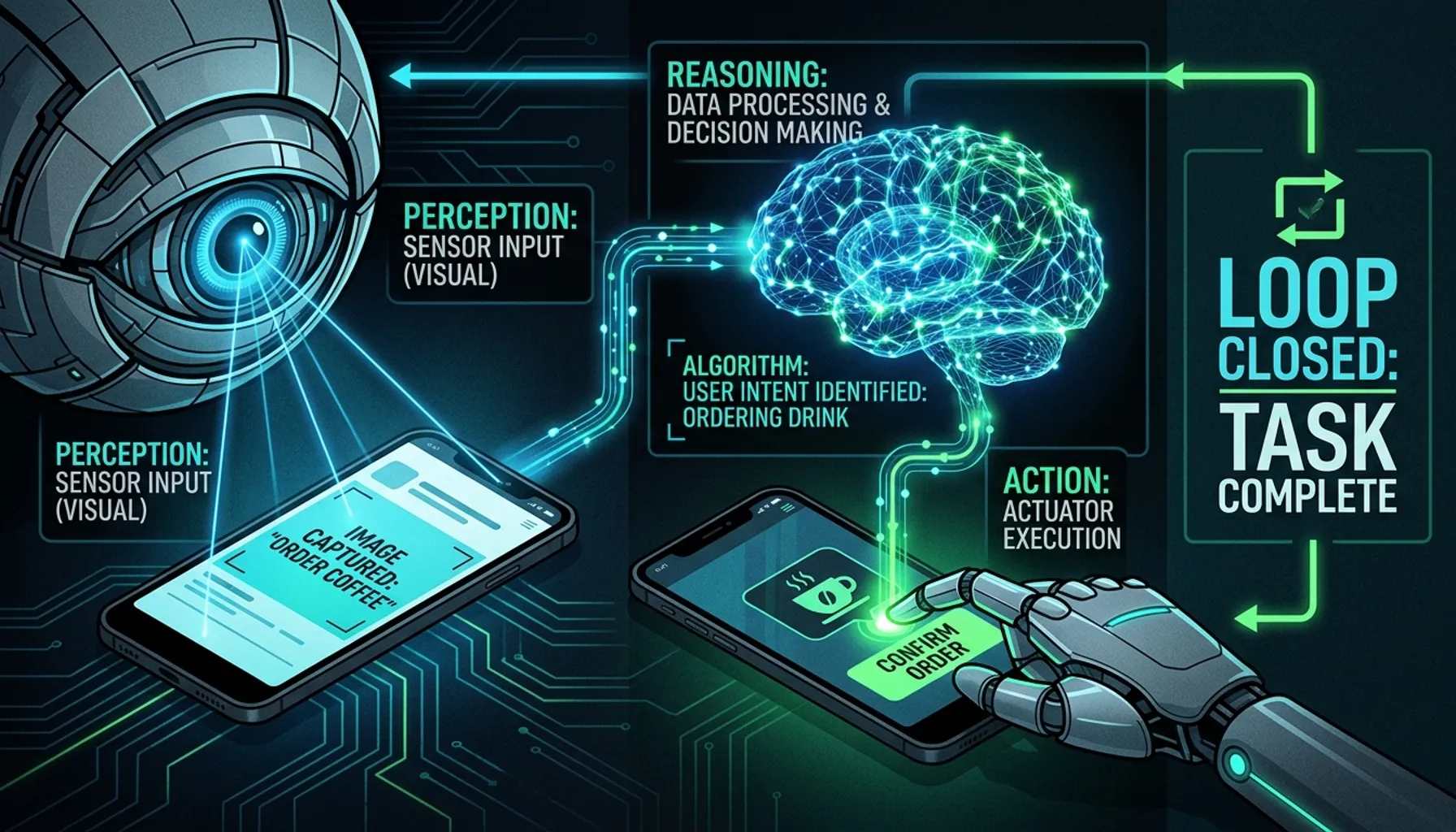

眼睛:像人一样”看”屏幕

AutoGLM 的核心突破在于:它不读代码,不读标签,不读 UI 树。它直接看屏幕截图。

就像一个真人用户拿到一部陌生手机,不需要知道 App 的源代码,不需要了解哪个按钮绑定了什么事件。他只需要看屏幕——“哦,这里有个搜索框,这里有个购物车图标,这个红色按钮是确认下单”。

AutoGLM 的”眼睛”是一个 9B 参数的多模态视觉语言模型(AutoGLM-Phone-9B)。它的工作方式:

- 截取当前屏幕:通过 ADB(Android Debug Bridge)获取实时截图

- 视觉理解:模型分析截图中的所有 UI 元素——按钮、文字、图标、输入框、列表

- 空间定位:精确识别每个元素的位置坐标,知道”下单按钮在屏幕右下角 (x:890, y:1650)”

- 语义理解:不只是识别元素,还理解它们的含义和上下文关系

这种基于视觉的方案有一个巨大优势:它不依赖任何 App 的内部实现。

无论是微信、淘宝还是任何新出的 App,只要界面画出来了,AutoGLM 就能看懂。不需要 App 开发者做任何适配,不需要无障碍标签,不需要系统权限。一张截图,就够了。

在 AutoGLM 2.0 中,”眼睛”由 GLM-4.5V 担当——一个拥有 1060 亿总参数(120 亿激活)的视觉语言模型,在 42 个多模态基准测试中达到了同级别开源模型的最佳性能。

大脑:规划与落地的双脑协同

看懂屏幕只是第一步。看懂之后,怎么行动?

这就是 AutoGLM 最精巧的设计:双脑协同架构。

规划大脑:GLM-4.5

负责”想”。接收用户的自然语言指令,理解意图,拆解成一系列步骤。

你说”帮我订明天下午 3 点从北京到上海的高铁票”,规划大脑的思考过程大概是:

- 打开 12306 或携程

- 搜索北京到上海的高铁

- 筛选明天下午 3 点左右的车次

- 选择合适的座位

- 确认乘客信息

- 完成支付

这个过程需要逻辑推理、常识判断、多步规划。GLM-4.5 作为智谱的旗舰语言模型,原生融合了推理、编码和 Agent 能力,支持”混合推理”模式——简单任务快速响应,复杂任务深度思考。

落地大脑:GLM-4.5V

负责”做”。接收规划大脑的抽象指令(”打开 12306”),在真实屏幕上找到并执行具体操作。

它需要回答的问题是:12306 的图标在屏幕的哪个位置?搜索框在哪里?”查询”按钮长什么样?车次列表怎么滚动?

为什么要分两个大脑?

智谱的研究发现:将”规划”和”落地”解耦,是提升 Agent 能力的关键。

规划需要的是逻辑灵活性和推理深度——知道该做什么。落地需要的是视觉精度和操作精确性——知道怎么在屏幕上执行。

让一个模型同时处理这两件事,就像让一个人同时下棋和打乒乓球。分成两个专家,各自做最擅长的事,效果远好于一个全能但平庸的通才。

手:ADB/HDC 执行操作

“眼睛”看懂了屏幕,”大脑”规划好了步骤,最后需要”手”来执行。

AutoGLM 的”手”是 ADB(Android Debug Bridge)或 HDC(HarmonyOS Device Connector)。模型输出的操作指令被翻译成具体的设备命令:

| 操作类型 | 示例 |

|---|---|

| 点击 | do(action="Tap", position=[450, 800]) |

| 滑动 | do(action="Swipe", startPos=[500, 1500], endPos=[500, 500]) |

| 输入文字 | do(action="Type", text="黄焖鸡米饭") |

| 启动应用 | do(action="Launch", app="美团") |

| 返回 | do(action="Back") |

| 等待 | do(action="Wait", duration=2) |

整个流程形成一个循环:

1 | 截屏 → 视觉理解 → 规划下一步 → 执行操作 → 截屏 → ... |

每一步都会重新截屏、重新理解、重新决策。这意味着即使界面发生了意外变化(弹出广告、加载延迟、布局改变),AutoGLM 都能实时应对,而不是像传统自动化脚本那样直接崩溃。

开源了什么:拿来就能用的全套

AutoGLM 的开源不是扔一个模型权重就完事了。它开源了一整套可落地的框架:

模型层:

- AutoGLM-Phone-9B:基础版,9B 参数

- AutoGLM-Phone-9B-Multilingual:多语言版,支持中英文

- 托管在 HuggingFace 和 ModelScope,MIT 协议

框架层:

- 完整的 Phone Agent 代码,Apache-2.0 协议

- 支持 Android(ADB)、HarmonyOS(HDC)、iOS(WebDriverAgent)

- 支持本地部署(vLLM/SGLang)和云端 API

- MCP Server 接入,可通过 Claude Desktop 等工具调用

- 远程 ADB 调试,WiFi 连接设备

工具链:

- 自动化测试脚本

- 部署验证工具

- 详细文档和教程

一行命令启动:

1 | python main.py \ |

如果不想自己部署模型,直接用智谱的 API:

1 | python main.py \ |

和小米 miclaw、豆包手机有什么区别

三个方案,三种路线:

| 维度 | AutoGLM | 小米 miclaw | 豆包手机 |

|---|---|---|---|

| 核心技术 | 视觉大模型 + ADB | 系统 API + Intent | 无障碍服务模拟点击 |

| 开源 | 完全开源(MIT + Apache-2.0) | 闭源 | 闭源 |

| 设备限制 | 任何 Android/HarmonyOS/iOS | 仅小米 17 系列 | 需要特定权限 |

| App 适配 | 无需适配,看截图即可 | 需要系统封装工具 | 无需适配但易被封 |

| 被封号风险 | 低(ADB 操作) | 极低(系统级) | 高(模拟点击) |

| 生态 | 开放,任何厂商可用 | 封闭,仅小米生态 | 封闭,字节生态 |

| IoT 联动 | 不支持(纯手机端) | 支持米家 10 亿+ 设备 | 不支持 |

| 部署门槛 | 需要技术基础 | 零门槛 | 零门槛 |

一句话总结:

- AutoGLM:技术最硬核,生态最开放,但需要动手能力

- miclaw:体验最丝滑,生态最完整,但被锁在小米设备里

- 豆包:最通用,但被封号风险最高

AutoGLM 最大的价值在于开源。它不是一个产品,是一个基础设施。任何手机厂商——OPPO、vivo、华为、三星——都可以基于 AutoGLM 做自己的手机 Agent。不需要从零训练视觉模型,不需要从零搭建操作框架。拿来就用。

安全设计:敏感操作必须确认

一个能操作手机的 AI,安全怎么保障?

AutoGLM 内置了几层安全机制:

第一,敏感操作确认。 涉及支付、删除、发送消息等敏感操作,Agent 会暂停并请求用户确认。不会默默帮你付了 3000 块的机票。

第二,登录场景人工接管。 遇到需要输入密码、验证码的场景,Agent 会提示用户手动完成,然后继续后续操作。不会尝试猜你的密码。

第三,云手机隔离。 AutoGLM 支持在云手机上运行——AI 操作的是云端的虚拟设备,不是你手里的真机。数据和操作完全隔离。

第四,本地部署。 模型可以完全本地部署,不需要把任何数据发到云端。智谱官方也声明,AutoGLM 的交互数据不会用于模型训练。

写在最后

AutoGLM 的开源,可能是 2026 年手机 AI 领域最重要的事件之一。

不是因为它的技术最先进(虽然确实很强),而是因为它改变了游戏规则:以前只有大厂才能做手机 Agent,现在任何人都可以。

一个独立开发者,一台 Android 手机,一块 GPU(或者直接用 API),就能跑起来一个能看屏幕、能思考、能操作的手机 Agent。

社区里已经有人做了 Operit AI——一个基于 AutoGLM 的纯手机端 Agent,不需要连电脑,支持语音操控,甚至能小窗后台运行。还有人做了 MCP Server,让 Claude Desktop 直接控制手机。

一个 AutoGLM 开源了,千千万万个手机 Agent 要站起来了。

正如那句话所说:这件事只在一家公司做,是不够的。

你想让 AI 帮你操作手机做什么?是自动点外卖、自动回消息,还是自动刷短视频?如果你是开发者,会基于 AutoGLM 做什么应用?评论区聊聊你的想法。