GLM-5V-Turbo 发布:国产多模态 Coding 模型来了,看图写代码到底有多强?

哈喽,我是飞飞。

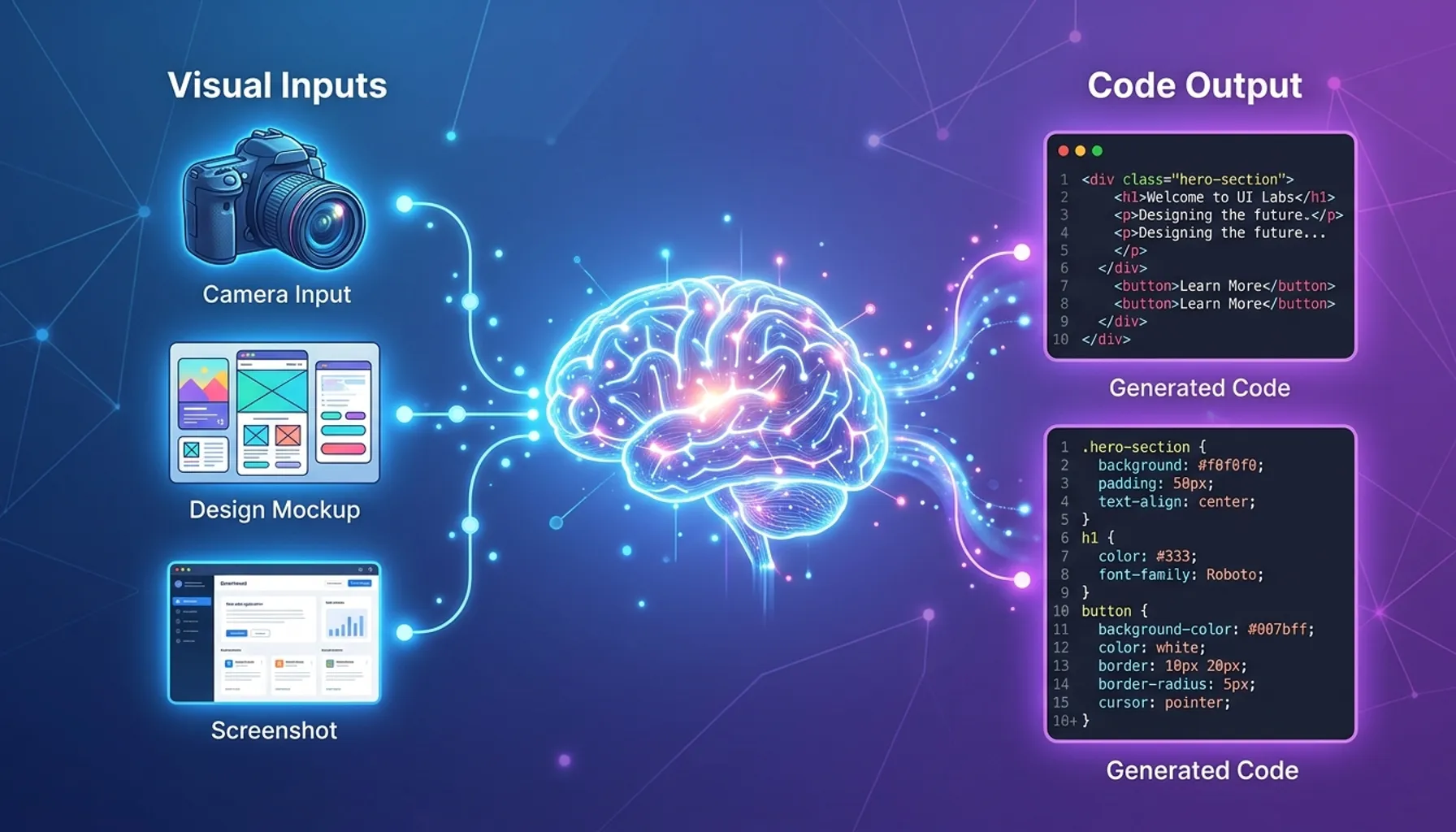

昨天智谱发布了 GLM-5V-Turbo,朋友圈被刷屏了。这次不是常规的文本模型升级,而是一个能”看懂设计稿、直接写代码”的多模态 Coding 基座模型。

我第一反应是:又一个多模态模型?但看完 Benchmark 数据,我愣了——在 Design2Code 这个”截图转代码”的测试里,GLM-5V-Turbo 得分 94.8,Claude Opus 4.6 只有 77.3。这差距有点大。

今天花了一下午时间,把官方文档、技术博客、还有几个实测视频都看了一遍。聊聊我的理解。

先说结论:这是一个专门为”视觉编程”设计的模型

GLM-5V-Turbo 不是通用多模态模型的又一个变种。它的定位很明确:在 GLM-5-Turbo 的编程和 Agent 能力基础上,从预训练阶段就融入了原生的视觉理解能力。

什么叫”原生”?

很多多模态模型是这么做的:先训一个文本模型,再训一个视觉编码器,最后把两个模块拼起来,中间加个”翻译层”。这种做法的问题是,视觉信息要先转成文字描述,再喂给语言模型。

GLM-5V-Turbo 的做法是:从预训练阶段开始,图像、视频、文本就是平等的输入。模型直接理解像素、布局、颜色、组件层级,不需要中间转换。

这带来一个直接的好处:它能看懂一张设计稿里的视觉细节,然后生成对应的代码——不是描述这张图,而是直接写出能跑的 HTML/CSS/JS。

核心能力:看图写代码,不只是前端

Design2Code:从设计稿到可运行代码

这是 GLM-5V-Turbo 最亮眼的能力。

你可以给它一张手绘草图、Figma 设计稿、或者某个网站的截图,它会:

- 理解布局结构(哪里是导航栏、哪里是内容区)

- 识别视觉细节(配色、字体、间距、圆角)

- 推断交互逻辑(按钮点击、表单提交、动画效果)

- 生成完整的前端代码

官方给的案例里,有一个是手绘草图转网页。左边是纸上画的线框图,右边是生成的完整前端页面——不是静态截图,是真的能跑的代码。

更夸张的是”GUI 自主探索复刻”。你给它一个目标网站的 URL,它会:

- 自己打开浏览器,浏览整个网站

- 梳理页面结构和跳转关系

- 采集素材(图片、文案)

- 生成代码,复现整个站点

这个能力结合了 Claude Code 的 Agent 框架。模型不只是”看一张图、写一段代码”,而是能完成”探索 → 理解 → 规划 → 实现”的完整闭环。

不只是前端:纯文本 Coding 能力没退化

多模态模型有个经典问题:加了视觉能力之后,文本能力会下降。这叫”跷跷板效应”。

GLM-5V-Turbo 的数据显示,它在纯文本 Coding 上的表现,跟纯文本版的 GLM-5-Turbo 基本持平,个别项还略有提升:

- CC-Backend(后端编程):22.8 vs 20.5

- CC-Frontend(前端逻辑):68.4 vs 69.4

- CC-Repo-Exploration(代码库探索):72.2 vs 68.9

这说明视觉能力的引入,没有牺牲编程逻辑。

当然,跟 Claude Opus 4.6 比,GLM-5V-Turbo 在纯文本 Coding 上还是有差距的。Opus 4.6 在 CC-Backend(26.9)、CC-Frontend(75.9)、CC-Repo-Exploration(74.4)上都领先。

但 GLM-5V-Turbo 的优势在于:它在多模态 Coding 场景下,表现明显更强。

技术上做对了什么?我挑三个关键点

技术博客里堆了一堆术语,我挑三个我觉得最关键的说。

第一,它从训练第一天开始就把图像和代码绑在一起练,不是后期拼接。

这意味着它”看图”的时候,脑子里想的就是代码结构,不是文字描述。很多多模态模型是先把图转成文字(”这是一个蓝色按钮,位于页面右上角”),再让语言模型根据文字写代码。GLM-5V-Turbo 跳过了这一步,直接从像素到代码。

这也是为什么它在 Design2Code 上能甩开 Opus 4.6 那么多——它理解的是”这个按钮应该用什么 CSS 实现”,而不是”这个按钮是蓝色的”。

第二,它用了 30 多个任务一起训,避免了”顾此失彼”。

多模态模型有个经典问题:加了视觉能力,文本能力就掉。智谱的做法是在强化学习阶段,同时优化视觉理解、代码生成、逻辑推理、工具调用这一堆任务。模型不能只在某一项上刷分,得在所有任务上都过关。

从数据看,这个策略确实有效——GLM-5V-Turbo 的纯文本 Coding 能力跟纯文本版基本持平,没有明显退化。

第三,它给 Agent 加了”眼睛”和”手”。

除了看图写代码,GLM-5V-Turbo 还支持画框(在图像上标注元素)、截图、读网页这些多模态工具。这让它能完成”看懂界面 → 定位元素 → 执行操作”的完整闭环。

这个能力在 GUI 自动化场景下特别有用。比如你让它”打开某个网站,找到登录按钮,填写表单”,它能自己看着屏幕一步步操作,不需要你提前告诉它按钮在哪。

官方案例看着挺炫,但我有几个疑问

PDF 文档解读:准确度是个问号

官方案例里,有一个是把 NVIDIA 2026 财年第一季度 10-Q 财报扔给模型,让它生成中文财务简报。模型输出了包含营收、利润、毛利率、EPS 等关键数据的结构化报告。

我看了一下输出,格式确实工整。但数据提取的准确度我没法验证——这种场景最怕的就是模型看漏了关键数字,或者理解错了表格结构。如果你要用在正式场合,建议人工再核一遍。

另一个案例是把 40 页的 GLM-5 论文 PDF 转成微信公众号风格的宣传文案。模型自动从原文中定位和截取关键图表,嵌入到合适的位置。这个我觉得靠谱一些——因为公众号文案对准确度要求没那么高,主要是排版和可读性。

PDF-to-WEB / PDF-to-PPT:适合快速原型

智谱把这两个能力做成了官方 Skill。

PDF-to-WEB 是把论文或报告转成单页学术网站。用 BERT 论文和 GLM-5 论文做的实测,渲染结果的完成度确实不错。但我估计细节还是得手工调——字体、间距、响应式布局这些,AI 很难一次做到位。

PDF-to-PPT 则是把文档转成多页 HTML 演示文稿。比如用阿里巴巴的近期动态做了一个 14 页的分析 PPT。这个场景我觉得挺实用的——如果你需要快速做一个汇报 PPT,让模型先搭个框架,你再调整内容和排版,能省不少时间。

多模态 Deep Research:看起来很强,但成本呢?

案例一:「搜集小米汽车相关图片,输出图文交错的专题报告」。模型通过约 50 轮网络搜索,从各个渠道获取了车型图片、产线照片,输出了一份结构化报告。

50 轮搜索,这 token 消耗得有点猛。如果你只是想快速了解一个话题,这个成本可能不划算。但如果你需要一份完整的研究报告,而且愿意为此付费,那确实能省很多人工时间。

案例二:「结合阿里巴巴的近期动态和季度财报,仿照麦肯锡风格,生成专业 PPT」。这个我觉得更适合咨询公司或者投资机构——他们本来就需要大量这种研究报告,用 AI 来加速是合理的。

Benchmark 数据:多模态场景领先,纯文本有差距

先看多模态相关的指标。对比对象是 Kimi K2.5 和 Claude Opus 4.6。

| Benchmark | GLM-5V-Turbo | Kimi K2.5 | Opus 4.6 |

|---|---|---|---|

| Design2Code | 94.8 | - | 77.3 |

| ImageMining | 82.4 | 79.1 | 81.2 |

| BrowseComp-VL | 78.5 | 72.3 | 75.1 |

| MMSearch | 71.2 | 68.4 | 69.8 |

| AndroidWorld | 45.3 | 41.2 | 43.7 |

在多模态 Coding 和 GUI Agent 相关的测试里,GLM-5V-Turbo 基本都是最高分。

再看纯文本 Coding 和 Agent 任务:

| Benchmark | GLM-5V-Turbo | GLM-5-Turbo | Opus 4.6 |

|---|---|---|---|

| CC-Backend | 22.8 | 20.5 | 26.9 |

| CC-Frontend | 68.4 | 69.4 | 75.9 |

| CC-Repo-Exploration | 72.2 | 68.9 | 74.4 |

| PinchBench | 42.1 | 43.5 | 48.3 |

| ClawEval | 38.7 | 39.2 | 44.6 |

纯文本 Coding 上,Opus 4.6 全面领先。但 GLM-5V-Turbo 跟纯文本版的 GLM-5-Turbo 相比,没有明显退化,个别项还略有提升。

定价和可用性

GLM-5V-Turbo 的定价是:

- 输入:$1.20 / 百万 tokens

- 输出:$4.00 / 百万 tokens

对比 Claude Opus 4.6(输入 $15 / 百万 tokens,输出 $75 / 百万 tokens),GLM-5V-Turbo 的价格是 Opus 的 1/10 左右。

如果你主要用多模态 Coding 场景(截图转代码、设计稿还原、GUI 自动化),GLM-5V-Turbo 的性价比很高。

目前可以通过以下方式使用:

- 智谱 AI 开放平台(https://open.bigmodel.cn)

- OpenRouter(https://openrouter.ai)

- 集成到 Claude Code、OpenClaw 等 Agent 框架

我的使用建议:别盲目跟风

看完这些数据和案例,我的判断是:GLM-5V-Turbo 是一个”场景特化”的模型,不是万能工具。

如果你是前端,手里有一堆设计稿要还原,GLM-5V-Turbo 值得试试——至少能帮你搭个框架,省掉重复劳动。但别指望它一次就写对所有细节,尤其是复杂交互和边界情况,还是得你自己调。

如果你在做 GUI 自动化(浏览器操作、App 测试),这模型的视觉理解能力确实有用。它能看着屏幕找元素、判断状态,比纯文本 Agent 灵活很多。

如果你需要处理大量 PDF 文档(财报、论文、合同),可以用它来做初步提取和整理。但涉及关键数据的场景,一定要人工复核——AI 看错表格、漏掉数字的概率不是零。

如果你是后端开发者,或者主要做深度推理任务,老实说,这模型对你帮助不大。Opus 4.6 在纯文本 Coding 上全面领先,而且上下文窗口是 1M(GLM-5V-Turbo 只有 200K)。

如果你预算有限,又刚好在多模态 Coding 场景,GLM-5V-Turbo 的性价比确实高——价格是 Opus 的 1/10,多模态能力还更强。但如果你需要的是全面的编程能力,还是得看 Opus。

最后说几句掏心窝的

GLM-5V-Turbo 的发布,让我看到了一个趋势:多模态模型的竞争,正在从”谁更全能”变成”谁在特定场景下更好用”。

以前大家都在卷”谁的多模态理解更强”,恨不得一个模型包打天下。现在开始有人选赛道了——GLM-5V-Turbo 选了”视觉编程”,把资源集中在 Design2Code、GUI Agent、文档理解这几个方向上,打出了差异化。

从 Benchmark 数据看,这个策略确实有效。它在多模态 Coding 场景下领先,但在纯文本 Coding 上跟 Opus 4.6 还有差距。这不是缺陷,这是选择。

说句可能得罪人的话:如果你还在纠结”哪个模型最强”,你可能问错了问题。 真正该问的是:”我的工作场景是什么?哪个模型在这个场景下最好用?”

GLM-5V-Turbo 在”看图写代码”这件事上确实做得不错。但如果你的工作主要是后端开发、深度推理,它不是最优解。

工具没有绝对的好坏,只有适不适合你的场景。

你在用多模态模型吗?有没有遇到过”看图写代码”的需求?或者你觉得 GLM-5V-Turbo 还能用在哪些场景?评论区聊聊,我想看看大家的实际需求。